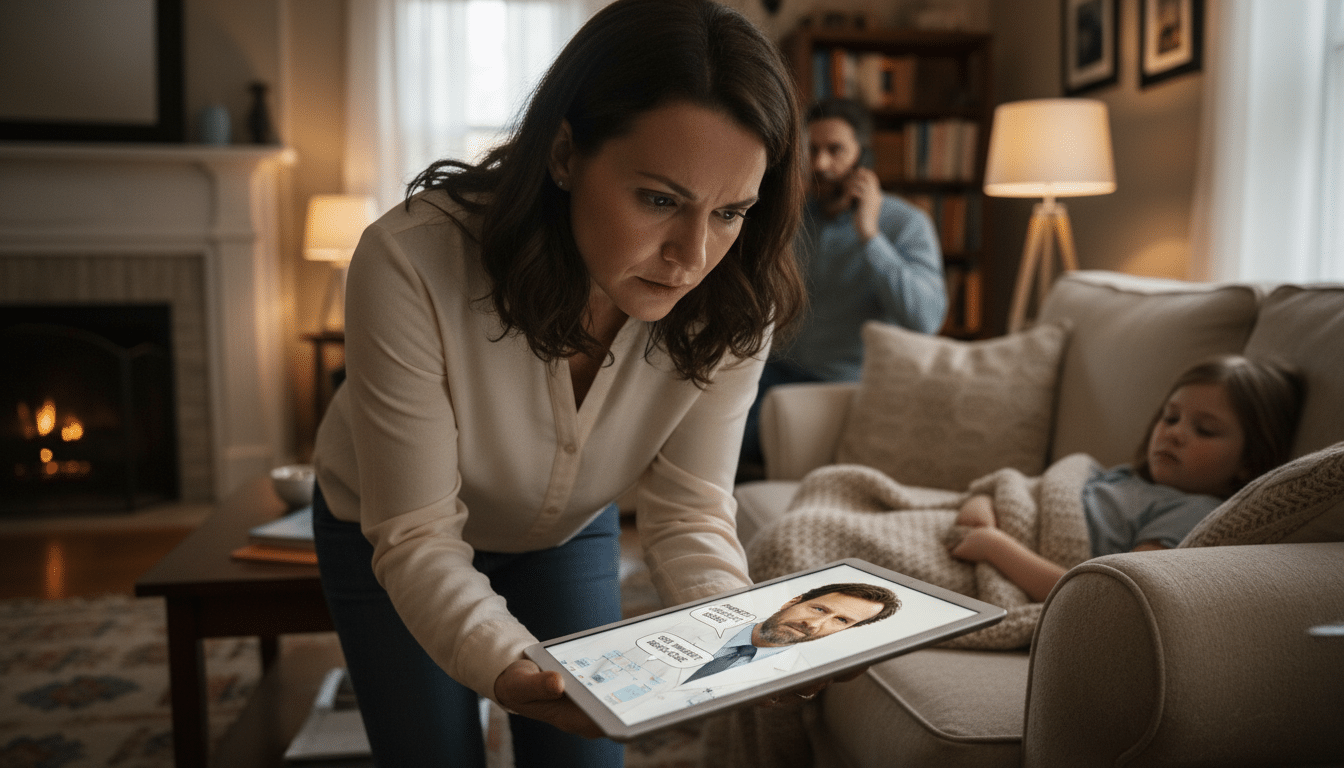

C’est une histoire qui semble tout droit sortie d’un scénario de série télévisée, mais qui s’ancre pourtant bien dans notre réalité de 2025. Imaginez un instant : une mère désemparée, un enfant souffrant de douleurs inexpliquées depuis des années, et une errance médicale épuisante. Là où dix-sept spécialistes n’ont pas réussi à poser un nom sur la maladie, une intelligence artificielle grand public a permis de débloquer la situation. Ce récit fascinant, où ChatGPT endosse le rôle du cynique mais brillant Dr House, soulève autant d’espoirs que de questions sur l’avenir de la santé de nos enfants.

Quand l’incertitude médicale rencontre la puissance de l’algorithme

Le parcours de soin d’un enfant peut parfois ressembler à un véritable labyrinthe pour les parents. Alex, un jeune garçon de 4 ans (au début de ses symptômes), souffrait de douleurs chroniques, de retards de croissance et de déséquilibres que les médecins attribuaient à des causes bénignes ou psychologiques. Pendant trois ans, sa mère a compilé chaque symptôme, chaque compte-rendu d’IRM et chaque analyse sanguine sans obtenir de réponse cohérente. C’est dans un moment de désespoir qu’elle a décidé de soumettre l’intégralité du dossier médical à l’IA.

Le résultat fut stupéfiant. En quelques secondes, le chatbot a suggéré une pathologie rare : le syndrome de la moelle attachée. Cette hypothèse, une fois présentée aux neurochirurgiens, a été confirmée, permettant une intervention chirurgicale cruciale. Cette affaire illustre parfaitement comment l’incroyable histoire de ce sauvetage par IA redéfinit notre rapport au diagnostic. L’outil n’a pas “inventé” la solution, mais il a su connecter des points isolés que la fatigue ou la spécialisation excessive des humains avaient laissés de côté.

Une technologie médicale qui écoute sans jamais s’impienter

Ce qui différencie ChatGPT d’un praticien humain, c’est sa capacité à traiter des volumes massifs de données sans biais émotionnel ni contrainte de temps. Là où un pédiatre dispose de quinze minutes pour une consultation, l’IA peut analyser des centaines de pages de notes en un instant. Elle offre une “seconde paire d’yeux” impartiale, capable de repérer des corrélations subtiles. Cependant, il est vital de rappeler que cet outil ne remplace pas l’expertise clinique, mais agit comme un lanceur d’alerte médicale sophistiqué.

Les limites de l’IA : vigilance et responsabilité parentale

Si ce sauvetage tient du miracle technologique, il ne doit pas faire oublier les risques inhérents à l’automédication numérique. L’intelligence artificielle peut “halluciner”, inventer des faits ou proposer des traitements dangereux. La prudence est donc de mise. Il est essentiel de vérifier les informations, surtout lorsqu’il s’agit de sujets sensibles comme les soins ou les dangers potentiels pour la santé des petits dans des environnements non médicalisés.

Pour aider les familles à y voir plus clair, voici un comparatif pour comprendre quand l’IA est pertinente et quand elle ne l’est pas :

| Critère 🧐 | Médecin Pédiatre 👩⚕️ | Assistant IA (ChatGPT) 🤖 |

|---|---|---|

| Empathie | Forte (écoute émotionnelle) | Nulle (simulation uniquement) |

| Responsabilité | Engagée légalement | Aucune garantie médicale |

| Analyse de données | Limitée au dossier connu | Immense (basée sur le web) |

| Examen physique | Indispensable et réel | Impossible |

| Prise de décision | Finale et experte | Suggestion informative |

Savoir réagir face à une urgence enfant

L’utilisation de la technologie médicale à domicile doit se faire avec discernement. Si l’IA peut suggérer des pistes de réflexion pour des maux chroniques, elle ne doit jamais retarder la prise en charge d’une urgence enfant vitale. Par exemple, lors de la recherche de solutions pour la surveillance ou les modes de garde et de surveillance, l’humain doit rester le décideur final.

Voici les situations où la consultation physique prime absolument sur le conseil numérique :

- 🤒 Fièvre élevée chez un nourrisson de moins de 3 mois.

- 🫁 Difficultés respiratoires marquées ou changement de couleur de la peau.

- 🤕 Traumatisme crânien avec perte de connaissance ou vomissements.

- 💊 Ingestion suspecte de produits toxiques ou médicamenteux.

- 🩸 Saignements abondants ne s’arrêtant pas après compression.

L’IA comme partenaire du dialogue médecin-patient

Plutôt que d’opposer la machine à l’homme, l’idéal est de les faire collaborer. Les parents peuvent utiliser ces outils pour préparer leurs consultations, lister les symptômes avec précision et poser des questions plus ciblées. Cela permet d’optimiser le temps passé avec le spécialiste. Dans le cas d’Alex, c’est bien la persévérance de sa mère, armée des informations fournies par l’IA, qui a poussé le corps médical à réévaluer le cas. Pour approfondir ce sujet, il est intéressant de comprendre comment l’IA a joué le rôle de Dr House sans jamais avoir enfilé une blouse blanche.

Il est fascinant de voir comment nos habitudes évoluent. Tout comme nous sommes attentifs à la composition des vêtements ou à la vigilance nécessaire dans les soins pour enfants, nous devons désormais apprendre à “consommer” l’information médicale numérique avec sagesse. L’objectif reste le même : offrir à nos enfants le cadre le plus sûr et le plus bienveillant pour grandir.

En définitive, si ChatGPT peut parfois agir comme un consultant de génie, l’intuition d’un parent et l’expertise d’un médecin restent les piliers indétrônables de la santé familiale. La technologie est un outil formidable, à condition qu’elle reste au service de l’humain et non l’inverse.

ChatGPT peut-il remplacer mon pédiatre ?

Non, absolument pas. ChatGPT est un modèle de langage qui peut traiter des informations et suggérer des pistes basées sur des données, mais il ne peut ni examiner votre enfant, ni poser un diagnostic officiel, ni prescrire de médicaments. Il doit être utilisé comme un outil de recherche complémentaire.

Quels sont les risques d’utiliser l’IA pour la santé de mon enfant ?

Le risque principal est l’erreur de diagnostic ou l’hallucination de l’IA (inventer des faits). Se fier uniquement à l’IA peut retarder une prise en charge médicale urgente nécessaire. Il y a aussi des risques liés à la confidentialité des données de santé partagées sur ces plateformes.

Comment présenter les informations trouvées par IA à mon médecin ?

Abordez le sujet avec humilité et ouverture. Dites par exemple : “J’ai noté ces symptômes et j’ai lu que cela pouvait parfois être lié à telle condition, qu’en pensez-vous ?”. Utilisez ces informations pour enrichir le dialogue, pas pour contester l’autorité médicale de front.

Camille dessine et imagine des vêtements pour enfants depuis plus de dix ans. Elle adore partager des conseils pour habiller les petits avec goût tout en privilégiant le confort et les matières responsables. Elle croit que chaque enfant mérite de s’exprimer à travers son style, même à 4 ans !

No responses yet